Процедура последовательных решений

Ранее предполагалось, что решение о принадлежности распознаваемого объекта w соответствующему классу Ωi, i=l, ..., m, принимается после измерения всей совокупности признаков этого объекта х1 ..., xN. Однако возможен и другой подход к решению этой задачи: после измерения каждого очередного признака x1;x1, х2; х1, х2, х3 и т. д. включается алгоритм распознавания и решается задача распознавания на основе данных об измеренных к текущему моменту признаках неизвестного объекта. При этом в зависимости от результатов сравнения полученного решения с некоторыми установленными заранее границами либо измеряется очередной признак объекта со, либо прекращается дальнейшее накопление информации об этом объекте. Такая процедура решения задачи распознавания, называемая последовательной, обязана своим возникновением одному из разделов статистики — последовательному анализу [17].

Последовательное и многократное решение задачи распознавания с использованием на каждом шаге все возрастающего числа измеренных признаков особенно целесообразно в случаях, когда определение признаков сопряжено с затратами на проведение экспериментов, процесс накопления экспериментальных данных требует затрат значительного количества времени, проведение экспериментов сопряжено с определенным риском (например, при постановке медицинского диагноза), объекты ряда классов из их общей совокупности надежно распознаются по ограниченному количеству признаков.

Рассмотрим суть последовательной процедуры распознавания. Пусть множество объектов подразделено на классы Ω1 и Ω2, рабочий словарь содержит признаки х1 ..., xN и функции условной плотности распределения вероятностей будут fi(x1); fi(x1, х2); ...; fi(x1 ..., xN), i=l, 2.

Допустим, что проведена серия, состоящая из n экспериментов, в результате которых определены признаки х1 ..., хn (n<N). Сопоставим отношения n-мерных функций условных плотностей распределения вероятностей ln=f1(x1, ..., хn)/f2(х1 ..., хn) с величинами А и В. При этом будем полагать следующее: если ln³А, то проведение экспериментов прекращается и принимается решение о том, что wÎΩ1 если ln£B, то проведение экспериментов также прекращается и принимается решение о том, что wÎΩ2; если В<ln <А, то принимается решение, что эксперименты необходимо продолжить и определяется очередной (n + 1)-й признак распознаваемого объекта.

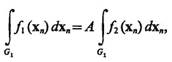

Постоянные А и В, называемые верхним и нижним порогами, могут быть определены из таких соображений. Пусть после измерения n признаков ln =А, тогда, обозначив xn={x1, ..., хn}, получим f1(хn)=Аf2хn или

(4.42)

где G1 — область пространства признаков, соответствующая классу Ω1.

Согласно определению условной вероятности ошибок первого Q1 и второго Q2 рода (4.42), можно записать так: l — Q1=AQ2. Аналогичные рассуждения приводят к соотношению Q1 = B(l — Q2). Отсюда в общем случае

(4.43)

Таким образом, для определения порогов А и В необходимо задаться допустимыми значениями ошибок первого и второго рода.

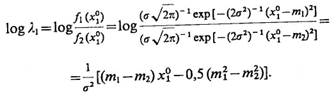

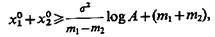

Рассмотрим, как определяются границы двух классов (m=2), описываемых гауссовыми функциями плотности с математическими ожиданиями m1 и m2 и дисперсией s2. При этом будем оперировать не отношением правдоподобия, а его логарифмом. Тогда

(4.44)

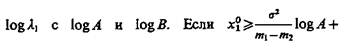

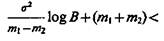

Сравним

то следует определить признак х2. Предполагая, что признаки х1 и х2 независимы и равны х1 = х01 и х1=х02, логарифм отношения верятностей

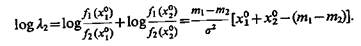

то следует определить признак х2. Предполагая, что признаки х1 и х2 независимы и равны х1 = х01 и х1=х02, логарифм отношения верятностей

(4.45)

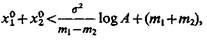

Если

то

то  если

если

то следует определить признак х3.

то следует определить признак х3.

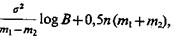

В общем случае, полагая, что признаки хj, j= 1,..., n, статистически независимы и равны х1 = х01, ..., хn=х0n, получим

(4.46)

Если  то

то ; если

; если

то

то  если

если

то необходимо произвести определение (n+ 1)-го признака.

то необходимо произвести определение (n+ 1)-го признака.

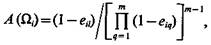

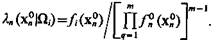

Если число классов m>2, то последовательная процедура состоит в следующем. Исходя из того, какие решения будут приниматься после распознавания неизвестных объектов, задаются допустимые значения вероятностей правильных (еii) и ошибочных (еiq) решений, что позволяет определить значения порогов для каждого класса, т. е.  i=1, ... m; q¹i. Пусть в результате проведения некоторой совокупности экспериментов определен вектор признаков х0n = {х01, ..., х0n) распознаваемого объекта и рассчитаны отношения вероятностей для каждого класса

i=1, ... m; q¹i. Пусть в результате проведения некоторой совокупности экспериментов определен вектор признаков х0n = {х01, ..., х0n) распознаваемого объекта и рассчитаны отношения вероятностей для каждого класса Сопоставим

Сопоставим  с соответствующим порогом А (Ωi), i= 1, ..., m. Если

с соответствующим порогом А (Ωi), i= 1, ..., m. Если  то принимается решение о том, что wÎΩi. Если наличие апостериорной информации о найденных признаках объекта не позволяет исключить все классы, кроме одного, то проводится следующий эксперимент с целью определения признака хn+1. После этого определяется ln+1 (x0n+1/Ω1) и производится его сравнение с порогом А (Ωi). Если при этом вновь не удается установить, что распознаваемый объект относится именно к данному классу, то принимается решение провести очередной эксперимент с целью определения признака хn+2.

то принимается решение о том, что wÎΩi. Если наличие апостериорной информации о найденных признаках объекта не позволяет исключить все классы, кроме одного, то проводится следующий эксперимент с целью определения признака хn+1. После этого определяется ln+1 (x0n+1/Ω1) и производится его сравнение с порогом А (Ωi). Если при этом вновь не удается установить, что распознаваемый объект относится именно к данному классу, то принимается решение провести очередной эксперимент с целью определения признака хn+2.

Подобная процедура последовательного нахождения признаков, определения на каждом шаге коэффициента правдоподобия l1(x01|Ωi), ..., ln(x01|Ωi) и сопоставления его с порогом А(Ω1) проводится до тех пор, пока последовательным исключением всех классов, к которым распознаваемый объект не относится, кроме искомого, не удается принять решение о принадлежности объекта именно к этому классу.