Формула Шеннона

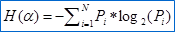

Энтропия системы H(a) согласно формуле Шеннона равна:

|

где H(a) – энтропия системы;

N – число возможных состояний системы;

P(i) –вероятность того, что система находится в i-ом состоянии.

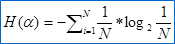

Для случая, когда все состояния системы равновероятны, т.е. их вероятности равны Pi = 1/N, её энтропия определяется соотношением:

|

Энтропия системы может рассматриваться как мера недостающей информации.