Вероятностные соотношения: совместная частота (вероятность), условная частота (вероятность), статистическая независимость случайных переменных

Под совместной частотой V(x,у) двух случайных величин Х и Y мы понимаем относительную частоту события, состоящего в том, что величины Х и Y принимают одновременно значения хи _у соответственно. В пределе, когда число наблюдений стремится к бесконечности, совместная частота переходит в совместную вероятность Р(х,у). Однако совместная частота или вероятность не являются характеристиками именно взаимосвязи случайных переменных, поскольку их значения определяются не только синхронностью изменения исследуемых случайных величин, но и частотой, с которой переменные принимают фиксированные значения. Поэтому для характеристики взаимосвязи случайных переменных чаще используют другую характеристику - условную частоту или вероятность.

Под условной частотой v(у|x) двух случайных величин Y и X мы понимаем относительную частоту события, состоящего в том, что величина Y принимает значение у при условии, что величина X уже приняла значение х. В пределе, когда величины Х и Y принимают все возможные значения из генеральной совокупности, условная частота переходит в условную вероятность Р(у|х).

Если величины Х и Y связаны функциональной зависимостью, например, Y=Х2, то условная частота (вероятность) Р(у)=х2|х) равна единице, так как в 100% случаях (с вероятностью единица) значению X будет соответствовать значение Y=Х2.

В противоположном случае, когда величины Х и Y cсовершенно не связаны между собой, условная частота v(у|x) никак не будет зависеть от значения х и будет совпадать с частотой появления значения у, v(у). При этом совместная частота будет пропорциональна частотам появления значений х и у: v(x,у)=v(x)•v(у). То же относится и к совместной вероятности независимых случайных величин Р(х,у)=Р(х) Р(у). Данное равенство является формальным определением независимости случайных величин х и у. они называются независимыми, если равенство Р(х,у) — Р(х) Р(у) выполняется для любых значений .x и у.

Если Х и Y независимы, то М[Х Y] = М[Х]М[Y], а D[Х+Y] = D[Х]+D[Y].

Анализ линейной статистической связи экономических данных. Корреляция

В экономических исследованиях одной из основных задач является анализ зависимостей между переменными. Зависимость может быть строгой (функциональной) либо статистической. Алгебра и математический анализ занимаются изучением функциональных зависимостей, то есть зависимостей, заданных в виде точных формул. Но любая такая зависимость в определенной степени является абстракцией, поскольку в окружающем мире, частью которого является экономика, значение конкретной величины не определяется неизменной формулой ее зависимости от некоторого набора других величин. Всегда есть несколько величин, которые определяют главные тенденции изменения рассматриваемой величины, и в экономической теории и практике ограничиваются тем или иным кругом таких величин (объясняющих переменных). Однако всегда существует и воздействие большого числа других, менее важных или трудно идентифицируемых факторов, приводящее к отклонению значений объясняемой (зависимой) переменной от конкретной формулы ее связи с объясняющими переменными, сколь бы точной эта формула ни была. Нахождение, оценка и анализ таких связей, идентификация объясняющих переменных, построение формул зависимости и оценка их параметров являются не только одним из важнейших разделов математической статистики. Это своего рода искусство, учитывающее в каждой конкретной области знаний (в частности, в экономике, о которой идет речь), ее внутренние законы и потребности. Но это также и наука, поскольку выбираемый и оцениваемый вид формулы должен быть объяснен в терминах данной области знаний.

Пусть требуется оценить связь между переменными Х и Y (например, связь показателей безработицы и инфляции в данной стране за определенный период времени). В частности, может стоять вопрос, связаны ли между собой эти показатели, и при положительном ответе на него, естественно, встает задача нахождения формулы этой связи. Основой для ответа на этот вопрос являются статистические данные о динамике этих показателей (годовые, квартальные, месячные и т.п.). Эти данные представляют собой некоторую, предположительно - случайную, выборку из генеральной совокупности, то есть из совокупности всех возможных сочетаний показателей инфляции и безработицы в сложившихся условиях.

Таким образом, вывод о наличии связи для всей генеральной совокупности нужно делать по выборочным данным, что само по себе уже делает ответ на поставленный вопрос небезусловным. Более того, поданным выборки ответить на вопрос в приведенной постановке, то есть о наличии связи "вообще", невозможно. Действительно, через любые N точек на плоскости всегда можно провести полином степени N-1 и объявить, что найдена точная формула связи. Однако опыт подсказывает, что если бы мы получили еще одну точку-наблюдение, то она наверняка не удовлетворяла бы найденной формуле. Поэтому вопрос о наличии связи между переменными (в частности - экономическими) следует ставить как вопрос о наличии конкретной формулы (спецификации) такой связи, устойчивой к изменению числа наблюдений. При этом нужно понимать, что ответ на этот вопрос по данным выборки не может быть однозначным и категоричным.

Простейшей формой зависимости между переменными является линейная зависимость, и проверка наличия такой зависимости, оценивание ее индикаторов и параметров является одним из важнейших направлений приложения математической статистики.

Рассмотрим вначале вопрос о линейной связи двух переменных

1) Связаны ли между собой линейно переменные Х и Y?

2) Какова формула связи переменных Х и Y?

В первом случае переменные Х и Y выступают как равноправные, здесь нет независимой и зависимой переменных. Во втором случае речь может идти о нахождении зависимости одной переменной от другой, например об оценивании формулы Y =а+b (где а и b - неизвестные коэффициенты такой зависимости). В этом случае переменная Х является независимой (объясняющей), а переменная Y - зависимой (объясняемой). Вопрос о нахождении формулы зависимости можно ставить после положительного ответа на вопрос о существовании такой зависимости, но эти два вопроса можно решать и одновременно.

Для ответа на поставленные вопросы существуют специальные статистические методы и, соответственно, показатели, значения которых определенным образом (и с определенной вероятностью) свидетельствуют о наличии или отсутствии линейной связи между переменными. В первом случае это коэффициент корреляции величин Х и Y, во втором случае - коэффициенты линейной регрессии а и b, их стандартные ошибки и г-статистики, по значениям которых проверяется гипотеза об отсутствии связи величин Х и Y.

Вначале объясним логику появления такого показателя, как коэффициент корреляции. Предположим, что между переменными X и Y существует линейная связь. Наличие такой связи можно интерпретировать следующим образом. Если переменная X принимает значения большие, чем ее среднее значение, и связь положительна (на языке формул это означает, что коэффициент b положителен), то значение переменной Y также должно быть больше ее среднего значения и соотношение отклонений Х и Y от их средних значений должно быть постоянным. Если в этом случае переменная Х принимает значение меньше, чем ее среднее значение, то и значение Y должно быть меньше ее среднего с тем же коэффициентом пропорциональности этих отклонений. Если связь переменных Х и Y отрицательна, то положительное отклонение Х от среднего значения должно сочетаться с отрицательным отклонением Y от ее средней, а отрицательное отклонение Х от среднего значения - с положительным отклонением Y от ее средней - при постоянном соотношении этих отклонений. Если линейной связи между переменными Х и Y нет, то положительные отклонения переменной Х от ее среднего значения могут (хотя и не обязательно будут) сочетаться как с положительными, так и с отрицательными отклонениями Y от ее среднего, то же можно сказать и про отрицательные отклонения Х от среднего.

Коэффициент корреляции для выборки и генеральной совокупности

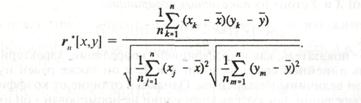

В качестве меры для степени линейной связи двух переменных используется коэффициент их корреляции. Приведем вначале формулу выборочного коэффициента корреляции переменных Х и Y:

По формуле коэффициента корреляции видно, что он будет положителен, если отклонения переменных А' и Кот своих средних значений имеют, как правило, одинаковый знак, и отрицательным - если разные знаки.

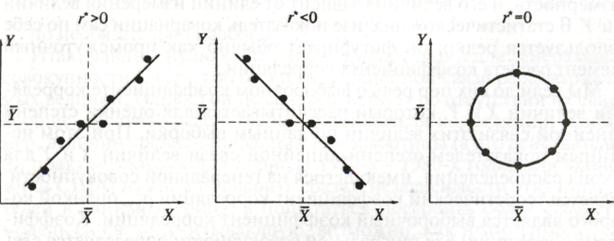

Коэффициент корреляции является безразмерной величиной (так как размерности числителя и знаменателя есть размерности произведения X Y); его величина не зависит от выбора единиц измерения обеих переменных. Величина коэффициента корреляции меняется от -1 в случае строгой линейной отрицательной связи до +1 в случае строгой линейной положительной связи. Случаи положительной и отрицательной корреляции переменных (с близкими по модулю к единице коэффициентами корреляции) показаны на рис. 12.

Рис. 12. Типы зависимостей и коэффициент корреляции

Близкая к нулю величина коэффициента корреляции говорит об отсутствии линейной связи переменных, но не об отсутствии связи между ними вообще. Это ясно из правой части рис. 12, где Х и Y, очевидно, связаны друг с другом (лежат на одной окружности), но их коэффициент корреляции близок к нулю. Последнее вытекает их того, что каждой паре одинаковых отклонений переменной Х от ее среднего значения соответствуют равные по абсолютной величине положительное и отрицательное отклонения переменной Y от ее среднего. Соответственно, произведения этих отклонений "гасят" друг друга в числителе формулы коэффициента корреляции, и он оказывается близким к нулю. Заметим, что в числителе формулы для выборочного коэффициента корреляции величин Х и Y стоит их показатель ковариации:

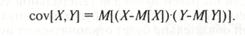

Этот показатель, как и коэффициент корреляции, характеризует степень линейной связи величин Х и Y, и он также равен нулю, если эти величины независимы. Однако, в отличие от коэффициента корреляции, показатель ковариации не нормирован - он имеет размерность, и его величина зависит от единиц измерения величин Х\ V. В статистическом анализе показатель ковариации сам по себе используется редко; он фигурирует обычно как промежуточный элемент расчета коэффициента корреляции.

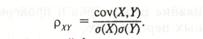

Мы вели до сих пор речь о выборочном коэффициенте корреляции величин Х и Y, который рассчитывается для оценки степени линейной связи этих величин по данным выборки. При этом истинным показателем степени линейной связи величин Х и Y для закона распределения, имеющегося на генеральной совокупности, является теоретический коэффициент корреляции рху, оценкой которого является выборочный коэффициент корреляции. Коэффициент корреляции для генеральной совокупности определяется следующим образом:

Стоящий в числителе этой формулы показатель ковариации величин Х и Y определяется следующим образом:

Используя показатель ковариации, удобно записать формулу для дисперсии суммы случайных величин Х и Y:

Исходя из определения коэффициента корреляции, покажем, что он равен 1 или -1 при строгой линейной зависимости величин Х и Y и равен нулю в случае их независимости.

Пусть Y=а+bХ. Тогда:

Очевидно также, что D[Y]=D[а+bХ]=b2D]Х], и  , то есть коэффициент корреляции равен 1 при положительном коэффициенте b и равен -1 при отрицательном b. Если Х и Y независимы, то:

, то есть коэффициент корреляции равен 1 при положительном коэффициенте b и равен -1 при отрицательном b. Если Х и Y независимы, то:

,

,

но необязательно наоборот.

Соответственно, равный нулю коэффициент корреляции для генеральной совокупности говорит об отсутствии линейной связи рассматриваемых величин. Однако он не свидетельствует об отсутствии их связи вообще. В случае равенства нулю показателя корреляции, например, величин уровней инфляции и безработицы (а это действительно практически так для периода 1970-х - 1980-х годов для экономики США) нужно не говорить сразу о независимости этих показателей в данный период, а попытаться построить более сложную модель их связи, учитывающую, возможно, как нелинейность самой зависимости, так и наличие в ней запаздываний во времени (лагов), а также инерционность динамики соответствующих величин.